关键词:标检测;机器人;IOU阈值;检测器

1 引言

计算机视觉是人工智能领域非常热门的研究方向,其包含了图像处理、模式识别、人工智能、信号处理、光机电一体化等多个领域,随着计算机视觉的发展,各式各样采集图像的设备层出不穷,丰富多彩的图像也因此遍及我们身边的每个角落,同时这些图像也为我们借助计算机来探索这个世界奠定了基础[1]。近年来通过人们对计算机视觉的研究,计算机已经可以借助大量图像理解我们周围的世界,感知我们周围的环境。比如,京东刚推出的无人机送货车,不久的将来将会代替快递小哥完成送货;百度推出的无人车自动驾驶等[2]。这些智能机的应用,对行人、车辆、障碍物、路标等目标的检测要求更加严格,这无疑把计算机视觉的研究推向又一个热潮。随着深度学习概念的提出,对目标检测的研究也不在局限于对某类目标的检测,而是对多类目标的检测[3]。无论是单目标检测还是多目标检测,目标检测技术都是重中之重。

2 Grid R-CNN目标检测框架

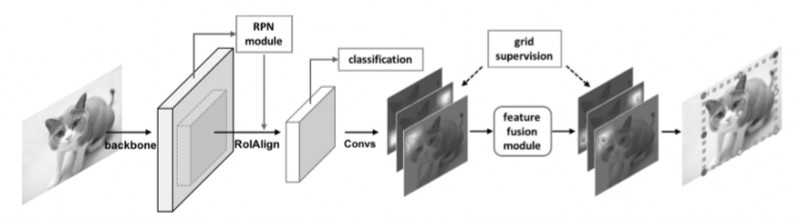

Grid R-CNN是基于Region proposal,每个RoI的特征独立的从CNN的feature map中提取,如图1所示。提取的ROI特征用于后续相应proposal的分类及定位工作。用网格引导机制预测定位来替换偏差回归。基于全卷积网络作为网格预测分支,输出一个空间map(概率heatmap),可以定位与目标物对齐的边界框的网格点[4]。借助网格点,通过feature map级别的特征融合,最终确定目标物的准确边界框。

Grid R-CNN将传统的回归部分替换为一个基于网格点定位的机制,显式的空间表示对于准确定位发挥重要作用。回归方法是将feature map通过一个全连接层压缩为一个向量,而Grid R-CNN将目标边界框划分为一个个格子,同时应用一个全卷积网络,预测格子中点的位置。由于全卷积结构具有位置敏感性,Grid R-CNN保存显式的空间信息,同时可以得到格子中点的位置信息[5]。当某个特定位置中一定数量的网格点确定,则对应的边界框位置也就确定了,由网格点指引,Grid R-CNN可以得到比传统回归方法更准确的空间信息。此外,为了更好的利用格子中点的相关性,Grid R-CNN提出了信息融合的方法。具体实现为,对每一个grid point 设计一个单独的feature maps集。对于一个网格点,其相邻点的feature maps融合为一张feature map。融合后的feature map用于对应网格点的位置预测。因此,结合网格相关点的空间信息,提高了位置预测的准确率。

图1 Grid R-CNN目标检测框架

3 Mesh三维目标检测框架

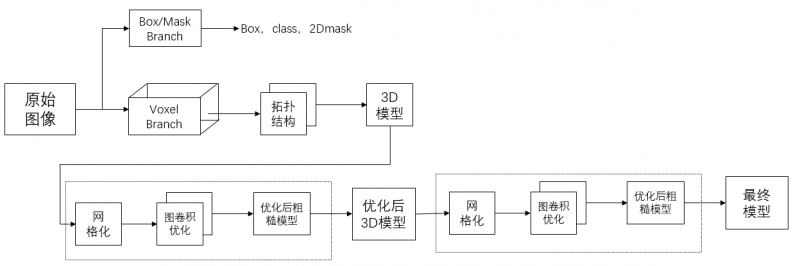

Mesh模型不同于传统的目标检测算法是一种结合图片与3D模型生成的网络,用于检测目标物体的位置与构建三维模型,克服了先前固定网格模板的形态预测方法,利用多种三维表示方法完成预测[6]。如图2所示,首先预测出目标粗糙的体素、随后转换为网格并利用精确的网格预测分支进行优化,最后实现了对于任意几何结构的精细预测。

2D目标检测在精度和速度方面已经得到了巨大的提升,并在各个领域取得了令人瞩目的成绩。但2D检测却忽视了物体的三维信息,目前的3D形状预测研究主要基于合成数据集和单个目标的预测。Mesh R-CNN(如图1-4)将对齐的图像特征进行输入,并输出目标的三维网格。与二维图像的处理相似,研究人员同时也维护了特征在不同阶段的对齐,包括区域和体素对应的对齐操作(RoIAlign和VertAlign),并捕捉图像中所有实例的3D形状。这意味着每一个预测出的网格都具有自己的拓扑结构(包括网格种类、一定数量的顶点、边和面)以及几何形状[7]。这一模型可以预测不同形状和拓扑结构的网格。通过网格预测分支可以得到每一个顶点的位置信息,实现了对于任意几何结构的精细预测[8]。同时,该模型可预测带有空洞的物体以及复杂环境下的物体。

图2 Mesh三维目标检测框架

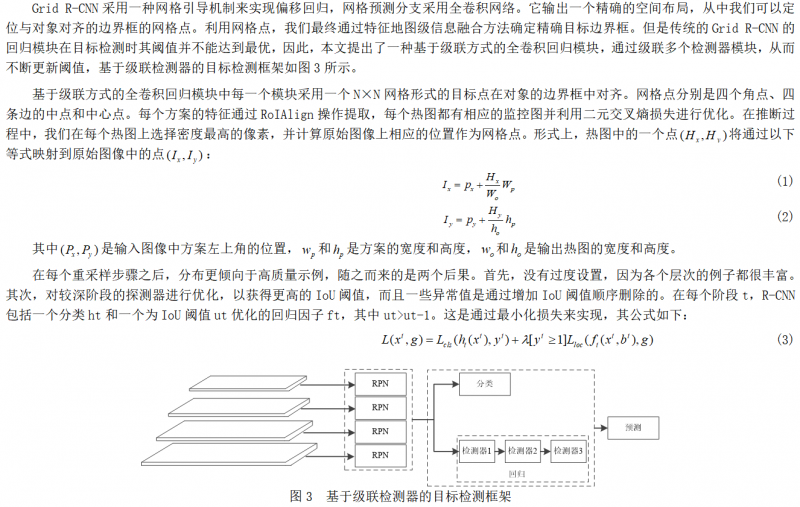

4 基于级联检测器的目标检测框架

为了验证所提方法的有效性,将所提方法与现有方法进行对比。采用基于TensorFlow的仿真平台,神经网络结构采用ResNet-50,数据集采用COCO,测试结果如表1所示。从附表中可以看出,在Grid R-CNN和Mesh目标检测框架中基于级联检测器的改进方法相比于原来方法在AP上分别提升了1.1%和0.9%,IOU阈值分别提升到0.63和0.58。

附表 不同目标检测框架性能对比

|

方法 |

AP |

IOU阈值 |

|

Grid R-CNN |

45.2 |

0.5 |

|

Mesh |

52.7 |

0.6 |

|

Grid R-CNN(级联) |

46.4 |

0.6 |

|

Mesh(级联) |

53.8 |

0.6 |

6 结束语

目标检测现如今已成为数字图像处理和计算机视觉的一个热门方向,广泛应用于医学图像、航空航天、视频监控以及人脸识别等领域。为了提高机器人在目标检测方面的性能,研究了基于深度神经网络的机器人目标检测方法,并提出了基于级联回归检测器的目标检测框架。在COCO数据集的测试结果表明,采用深度神经网络的机器人目标检测具有更有的性能,与现有的方法进行对比,所提出方法计有更优的AP和IOU阈值。将深度神经网络算法引入到机器人目标检测研究中对机器人技术研究和发展具有重要意义。

参考文献:

[1] 滕军. 智能工业机器人的环境感知与运动规划[D]. 哈尔滨工业大学,2019.

[2] 宁凯,张东波,印峰,肖慧辉.基于视觉感知的智能扫地机器人的垃圾检测与分类[J]. 中国图象图形报,2019,24(08):1358-1368.

[3] 方正,吴成东.自主导航:赋予移动机器人智能感知与运动的能力[J]. 自动化博览,2019(08):68-72.

[4] 韩业江,董颖,方敏,王思萌,胡春丹,李瑞波.基于情境感知技术的智慧图书馆服务策略研究[J]. 情报科学,2019,37(08):87-91.

[5] 杜铭浩.机器人感知技术及其简单应用[J]. 数字通信世界,2019(02):176-177.

[6] 孙晓红. 智能空间下面向个性化服务的机器人任务感知与远程监控系统设计[D]. 山东大学,2019.

[7] 李峰.浅谈机器人数目视觉感知系统的应用[J]. 南方农机,2020,51(03):21+26.

[8] 徐谦,李颖,王刚.基于深度学习图像语义分割的机器人环境感知[J]. 吉林大学学报(工学版),2019,49(01):248-260.

作者简介:

乔元健(1996— ) 男 工学硕士 齐鲁工业大学(山东省科学院)研究方向:工业测控网络技术

共0条 [查看全部] 网友评论