数据中心守护着企业重要IT设备的运行,如服务器、网络设备以及存储设备等,在数据中心支持全球数十亿人口上网的同时,也产生大量的机房能耗,因此,势必要研究具体的机房能效改善对策,才能真正实现节能。对于当前的数据中心管理者来说,必须采用高效率的机房经营方针,才能取得“环保”及“经济”双赢的好处。

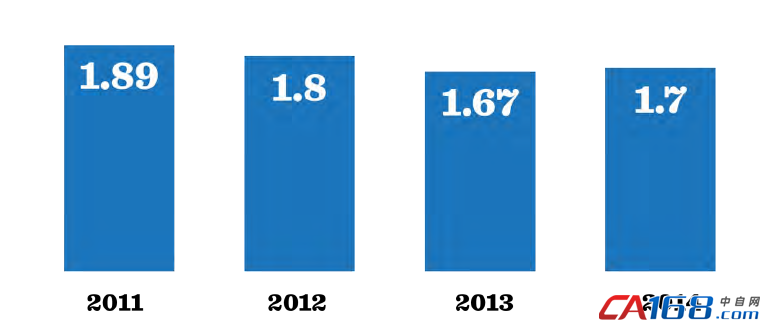

提升数据中心能源效率的第一步,便是审慎评估能源使用效率(PUE, Power Usage Effectiveness),简单来说,PUE就是数据中心总耗电除以IT设备总耗电,或是数据中心总设施消耗的能源除以IT设备消耗的能源。PUE是由Green Grid所召集的政府及产业专家组成的项目小组所制定的一项指标,不仅信赖度高,而且可以用来检验机房的能源效率,可以广为适用于一般数据中心,目的是建立一个“一致且可重复使用的衡量指标”,提供数据中心管理者持续监控并改善能耗状况。根据Uptime Institute于2014年进行的调查研究显示,全球业界平均PUE为1.7,高于2013年的1.67,但低于2012年的1.8,表示机房节能仍有改善空间(如图1)。

图1:数据中心平均PUE调查, 2011-2014

(数据来源:2014 数据中心产业调查报告--Uptime Institute)

受到近年来大数据、物联网浪潮的推动,各地的机房建设持续进行,同时,在环保意识高涨的氛围下,“机房节能”也成为了一门新的研究领域。从客观事实来看,首先,数据中心的电力支出占总持有成本(TCO, Total Cost of Ownership)的一大部分,仅次于人力成本;其次,数据中心常背负着“不环保”的恶名。然而,实际上,以美国为例,数据中心仅消耗了总能源的百分之二,且低于全世界平均值,可见仍有许多机房采用节能手段达到节能减排的目标。

截至目前为止,仍有许多数据中心尚未采用任何效率指标,导致数据中心的节能毫无标准可循。虽然PUE仍存有许多争议,但是PUE值仍是衡量数据中心基础设施效率的主要指导方针,而且对于拟定及执行数据中心的绿色节能策略也很有参考价值。

二、数据中心绿色节能策略

根据《自然气候变化(Nature Climate Change)》发表的一篇论文《低碳数据中心的特征》表示,IT设备如:服务器、存储设备、通讯技术、基础设施(风扇、冷却、水泵、配电等),其本身的效率以及碳排放,是影响数据中心产生温室气体的主要因素。这篇论文提出建议,如果专注于能耗改善的部分,将可对数据中心的绿色节能计划产生显著的影响。

以下列举七大数据中心的绿色节能策略,将有助于改善数据中心能耗,并优化PUE。

策略一:定期进行硬件检查

全球IT巨擘如Facebook、谷歌及苹果持续投入研发来提升数据中心的效率,他们的做法可能看似很了不起,但是这里所建议的第一个策略是属于大部分企业都能做到的,就是例行性检查既有的硬件设备。

数据中心普遍存在许多不必要的IT设备,所谓“休眠的服务器”指的是仍然插在机柜里,实际上却已不再使用的服务器,但是会占据宝贵的机柜空间,消耗大量能源,并且使PUE恶化。为了了解此问题的普遍性,Uptime Institute于2013年进行了一项相关调查,发现大约有半数的被调查者并未执行计划性的检查及拔除多余的服务器。此外,在美国EPA样本研究(U.S. EPA sample study)中,大部分机房的现场并无法准确地监控所有基础设施及IT负载,可见机房节能改善之路还很长。

以总部位于伦敦的英国巴克莱银行为例,该银行于2013年拔除了9,124个多余的服务器之后,不仅减少了使用的电力、冷却和机柜空间,同时并扩大了计算能力以及节省了450万美金的电费,可见减少服务器的好处非常明显。

除了IT设备的检查,对于非IT的基础设施,也必须做定期的检核,例如机房的不间断电源系统(UPS),有别于传统的工频单机UPS,当前的趋势是采用高频模块化UPS,为了达到机房节能,选用UPS时应该考虑以下两大条件:

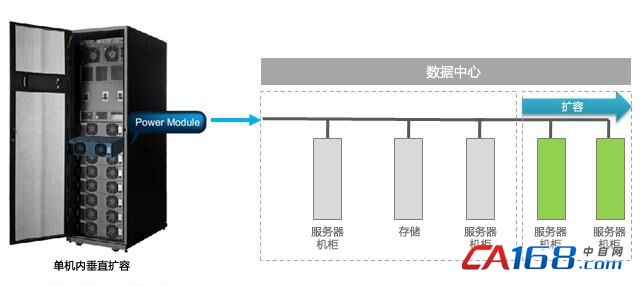

1.随需扩容:模块化UPS可以配合机房扩容的脚步,适时增加电源模块的数量,不需要在机房建置初期投入大量的资金,并且不占据多余的机房空间,使机房业务逐步成长时,UPS电源仍可“无缝接轨”(图2);除了增加电源模块,UPS也必须满足多机并联的需求,以因应机房规模扩大的可能性。

图2:模块化UPS满足机房无缝扩容的需求

2.轻载高效:一般数据中心为了确保可靠度,会配置电源冗余N+X,甚至配置2N双母线,导致负载率大约在30-40%甚至更低,因此UPS所标榜的“满载”高效率实际上是不太可能实现的。有鉴于此,市场调查机构Gartner在2013年的报告就指出,除了追求UPS满载效率之外,也要关注20-100%负载率区间的效率曲线(如图3),设法达到“轻载高效”的理想境界。以一台容量200kVA的高效率模块化UPS为例,考虑数据中心日间和夜间负载率的差异,相较于一般传统UPS,高效率UPS可以省电5%左右(表1)。

图3:UPS效率曲线

表1:高效率模块化UPS与传统UPS效率比

以UPS容量200kVA为例高效率模块化UPS传统UPS单位

日间供应的电源,负载率50%100100kVA

效率差异0%4%

总能耗100104kVA

日间能耗,假设有14小时14001456kVAh

夜间供应的电源,负载率30%6060kVA

效率差异0%7%

总能耗6064.2kVA

夜间能耗,假设有10小时600642kVAh

每天的能耗(日间+夜间)20002098kVAh

年度能耗,365天730000765770kVAh

策略二:例行测量PUE值

如前所述,PUE是量化能源效率的主要业界标准,大部分原因是其具有简单性及可行性,但是在观察的几个行业中却很少实施。不定期的纪录并无法确实了解实际的能源使用状况,所以业内人士不断建议执行例行性的PUE检测,以便监测数据中心PUE随季节变化及其他因素而波动。此外,为了能实时精确量测总电力,并纪录实际的PUE,必须在关键测量点安装传感器,并记录实际电力(kW及kVA),并且应该要记录一段时期之内的能源使用状况,才能做出最佳的分析(图4)。

图4:PUE值监测仪表板

策略三:更新硬件,提升服务器效率

服务器效率与PUE直接相关,而且是提升PUE的关键要素,但是想要正确估计服务器效率,还必须考虑几个因素。我们可以从CPU利用率出发,针对能效不佳的CPU,虚拟化技术(virtualization)可以大幅提升CPU能效及服务器的效率,而不需要更新服务器;此外,也应该将每一只机柜的负载能力与消耗电力,列入效率的计算中。采用刀片服务器(blade servers)是提高机柜密度的一种手法(每一机柜最多可容纳1,024 CPU核心),也可以降低设施的冷却及电力需求。

将实体服务器合并与虚拟化,将可提高数据中心效率,IT管理人员应该在硬件升级时将此列入考虑。根据研究指出,合并服务器的好处有:

l平均每年每一服务器最多可节省美金560元

l减少热量的产生及相关的冷却成本

l释出多余空间并扩大运算能力

值得注意的是,虚拟化技术及刀片服务器会产生一个负面影响,亦即会产生额外的热量及冷却需求。目前有数种解决方案,例如“冷热通道封闭”或是“机柜式空调(列间空调)”等气流管理手段,就是为了处理机房高密度负载的问题,请看以下策略四。

策略四:提升机房冷却效率

冷却是仅次于IT负载之外,最大的耗电来源,因此,安装能源监控及测量机制非常重要,可以了解冷却对于PUE的整体影响与改善的方法。

谷歌已是数据中心节能领域的佼佼者,具有令人称羡的PUE 1.12。在最新的Android Emotions报导中指出,最新的谷歌AI产品正在尝试找出能进一步降低PUE的方法。谷歌更在网志《Efficiency: How others can do it 》中,分享了数据中心经理人及经营者可用来降低PUE的五大手法,其中三项与提升机房冷却效率有关的做法是:

1、优化气流管理

设计良好的冷热通道封闭,可避免热空气和冷空气混合,以提升冷却系统的效率。为了有效排除机房热点,建立理想的热能分布状态,可以借由适当地放置温度传感器,利用计算机仿真工具找出热点并加以排除。根据EPA的研究,有效的冷热信道封闭系统,可减少25%的风扇能耗,以及20%的冰水主机能耗。

图5:热信道封闭技术实例

2、提高机房环境温度

谷歌已打破了数据中心必须保持约摄氏21℃的迷思,确认了冷通道可以在约摄氏27℃的温度下运转,因此在提高温度的同时,关闭再热器和除湿机,便可以有效节约能源。

3、采用自然冷却技术(Free Cooling)

空调系统的冰水主机会消耗大量的能源,可以视天候条件,选用自然冷却系统,将外面的冷空气吸进来,加以利用后再排放到外面去。其他自然冷却的来源包括:引入外界的空气、水蒸气或设置大型的热储存器。

策略五:提高机房温度

长久以来,机房IT人员受限于传统机房温度的迷思,不太愿意提高机房温度,然而,美国空调冷冻工程师学会(ASHRAE)最新发布的机房工作温度建议,范围修订为18℃至27℃(64.4°F至80.6°F);除了温度,ASHRAE也提高了湿度建议范围。受惠于这样的修订,数据中心将可以创造更多冷却成本的节约,也更能符合自然冷却的条件。

就机房温度而言,如果太过保守,维持机房低温,将会使营运成本居高不下,造成PUE值较差或冷却成本较高;此外,根据英特尔一项研究数据显示,机房环境温度每提升1℃可以带来4%的制冷成本节约。有鉴于此,一些高温节能产品就应运而生,举例如下:

§高温节能服务器:“高温”是指服务器耐高温能够在5℃至47℃环境温度下,无需空调制冷,能稳定运行,由于服务器能适应更高的机房温度,而带来制冷能耗的减少,相对传统服务器而言,高温节能服务器具有耐高温、低能耗、易部署等特点,对于机房节能也是一大功臣。

§高温冰水空调:一般机房内大多是属于显热,只有很少数的潜热,因此除湿的需求非常少,机房精密空调的入水温度便可以从一般的7℃往上调升,在此情况下,冰水主机的制冷量增加,能效比改善,也就争取更多空调节能的机会。

策略六:导入数据中心管理系统(DCIM)

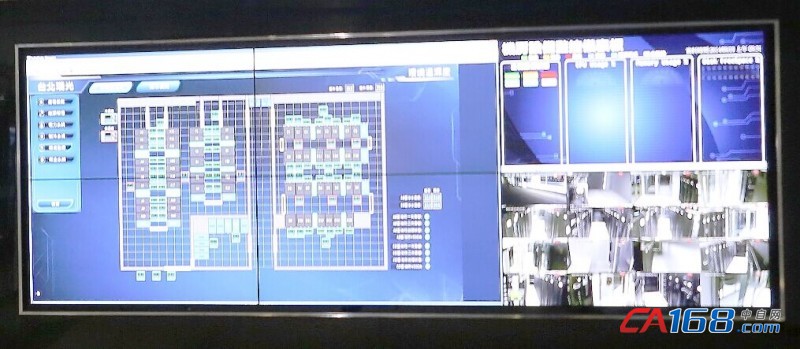

为了协助数据中心经营者更有效、全面地管理数据中心,数据中心基础设施管理系统(Date Center Infrastructure Management, DCIM)就应运而生。DCIM可通过机房鸟瞰图,协助IT经理人实时应对、事先规划、管理可能的风险,并减少停机时间。如前所述,个别服务器利用率低是数据中心普遍存在的问题,DCIM可协助数据中心人员找出长期闲置的服务器,加以重新配置,以提升效率,并准确测量数据中心资产及能源的使用状况。

图6:数据中心管理系统(DCIM)电视墙与机柜管理接口

策略七:利用纯净的再生能源

百分百纯净的能源是遥不可及的梦想,然而还是有许多企业用的是“混搭”策略来接近此理想目标。举例来说,包括利用再生能源、就地发电以及远距电网等等。IT巨擘如苹果所安装的55,000片太阳能板、eBay在犹他州Quicksilver工厂利用燃料电池,以及微软利用风力和太阳能。中小企业或许可以与当地公用事业合作,取得干净的电力或再生能源,也可在新数据中心选址时,考虑设置在纯净能源公用事业的周边地区。

三、结论

数据中心绿色节能需要发挥相当的创意,不应受到传统思维的局限。业界有许多案例均显示机房节能可以带来许多实质的好处,而PUE值可以作为一个能效指标的基础,对于创造永续的绿色数据中心而言是非常重要的。谷歌、Facebook、苹果及微软等IT大厂,皆已投资数百万元进行绿色数据中心的研发,且通过验证提出绿色数据中心最佳解决方案,能使数据中心的PUE接近理想值。业界一致认为必须全面稽核IT基础设施以提升数据中心的效率,同时,一般企业可以透过例行测量PUE,以及善用管理工具(如DCIM)找出并修正IT低效率的部分,减少碳排放,提高个别服务器的使用率,最终达到PUE及ROI优化的目标。

关于台达

台达创立于1971年,为电源管理与散热解决方案的领导厂商,并在多项产品领域居世界级重要地位。面对日益严重的气候变迁议题,台达秉持“环保 节能 爱地球”的经营使命,运用电力电子核心技术,整合全球资源与创新研发,深耕三大业务范畴,包含“电源及元器件”、“能源管理”与“智能绿生活”。同时,台达积极发展品牌,持续提供高效率且可靠的节能整体解决方案。

台达运营网点遍布全球,在中国大陆、台湾地区、美国、泰国、日本、新加坡、墨西哥、印度、巴西以及欧洲等地设有研发中心和生产基地。近年来,台达陆续荣获多项国际荣耀与肯定。自2011年起,台达连续四年入选道琼斯可持续发展指数之“世界指数(DJSI World)”,其中五项评分居全球电子设备产业之首;2014年国际碳信息披露项目(Carbon Disclosure Project, CDP)年度评比结果揭晓,台达从全球近2,000家参与CDP评比的上市企业中脱颖而出,不仅获得最高等级A级评价,更是大中华区唯一入选气候绩效领导指数 (Climate Performance Leadership Index, CPLI)之企业。

关于台达的详细资料,请参见:www.delta-china.com.cn

关于中达电通

1992年中达电通成立于上海,自营业以来,保持着年均增长30.7%的高速发展,为工业级用户提供高效可靠的动力、视讯、自动化及能源管理解决方案。在通信电源的市场占有率位居前列、同时也是视讯显示及工业自动化方案的领导厂商。

中达电通整合母公司台达集团优异的电力电子及控制技术,持续引进国内外性能领先的产品,在深入了解中国客户营运环境下,依据各行各业工艺需求,提出完整解决方案,为客户创建竞争优势。秉持“环保 节能 爱地球”的经营使命,成为中国移动的绿色行动战略伙伴,在节能减排、楼宇节能的技术上,陆续开展多项新应用。

为满足客户对不间断运营的需求,中达电通在全国设立了48个分支机构、74个技术服务网点与12个维修网点。依靠训练有素的技术服务团队,中达为客户提供个性化、全方位的售前、售中服务和最可靠的售后保障。

二十年深耕,在1500多名员工的努力下,中达电通2014年的营业额约三十一亿人民币。未来,中达更将不断推陈出新,藉由与客户的紧密合作,共同开创更智能、更环保的未来。

中达电通--可靠的工业伙伴!

关于中达电通的详细资料,请参见:www.deltagreentech.com.cn

共0条 [查看全部] 网友评论